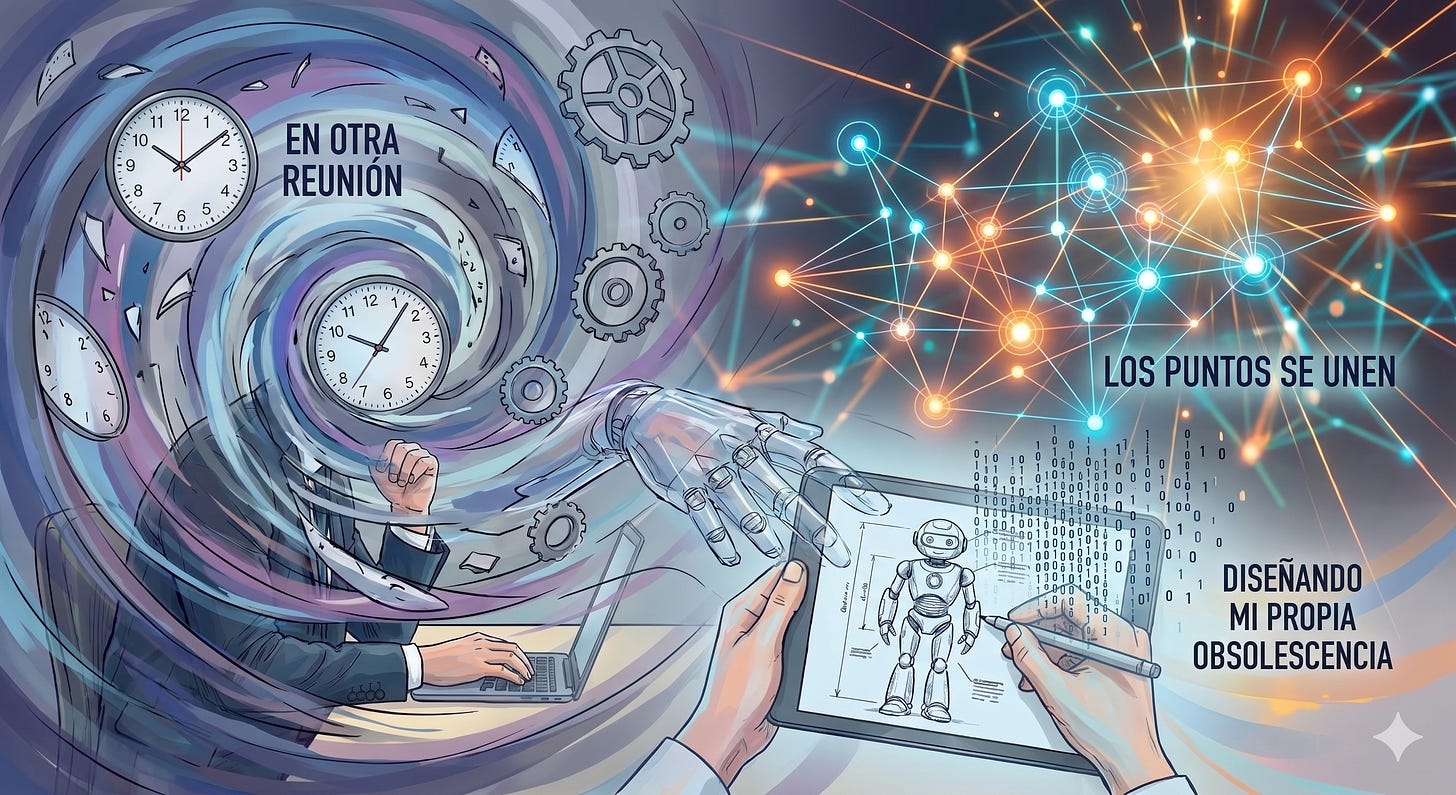

Los puntos se unen mientras estás en otra reunión

Diseñando mi propia obsolescencia, para seguir vigente

Slumdog Millionaire es una excelente película, a mi juicio, porque grafica como pocas cosas algo que dijo Steve Jobs alguna vez en Stanford: los puntos solo se unen mirando hacia atrás.

Recordemos la trama. Jamal, el protagonista, gana el premio mayor no por erudito, sino porque su trayectoria — marginal, trágica, a ratos cómica — le entregó, sin que él lo supiera, las respuestas exactas. Cada cicatriz, cada escena humillante, cada error termina siendo un dato útil. La película funciona porque uno cree esa lógica: la vida tiene una coherencia secreta que solo se revela cuando uno se da vuelta.

Construir con IA, a mi entender, se parece bastante a eso. Uno arma cosas con retazos — un script viejo, una intuición de hace tres años, un cliente que se enojó en 2022 y te enseñó algo que recién hoy entiendes — y, en algún momento, los puntos se conectan.

No obstante, hay una diferencia incómoda.

Con agentes, ya no necesitas esperar el final del concurso para que los puntos se unan. La tecnología — específicamente la basada en lenguaje — empieza a unirlos por ti, en tiempo real, mientras estás en otra reunión. Coordinas acciones a través de entidades que ejecutan, sincronizan, esperan, vuelven a ejecutar. El guión y el espectador empiezan a confundirse.

Lo que no me gusta del hype actual: muchos venden la fantasía de que esa coordinación es autónoma. Que los agentes “se hacen cargo”. Por lo pronto, mentira.

El reporte del MIT — State of AI in Business 2025 — sobre adopción de GenAI en empresas dice que el 95% de los pilotos no muestra ROI medible, a pesar de los 30 a 40 mil millones de dólares invertidos. Lo interesante no es el número, sino el diagnóstico: el problema no son los modelos. Es lo que llaman el “learning gap”. Los sistemas no retienen feedback, no se adaptan al contexto, no mejoran con el tiempo. Es decir, no es que la máquina no funcione; es que nadie está parado en el medio dándole sentido a lo que produce.

Dicho de otra manera: no hay observador.

Utilizando un sistema multiagente, por un error mío de configuración, dos agentes terminaron sosteniendo una conversación que me costó 50 dólares. Se pusieron a debatir por qué la idea de uno era mejor que la del otro, cuál era el camino estratégico más relevante y cómo avanzar de manera efectiva.

La discusión fue muy interesante. Pero cara.

Y aquí me pongo medio cargante con Maturana, pero vale la pena. El observador, decía don Humberto, no es un detalle secundario del sistema; es el que trae al mundo a la existencia. Sin alguien que distinga, no hay distinción. Sin alguien mirando, los puntos siguen siendo puntos. Píxeles sueltos en una pantalla que nadie está viendo.

Por eso el human-in-the-loop, a mi juicio, no es una concesión ética ni un parche transitorio mientras los modelos “maduran”. Es la condición de posibilidad de que esto signifique algo.

Claro, hay una corriente — fuerte, además — que dice lo contrario. Que el human-in-the-loop ya chocó contra el muro, que a la velocidad de la máquina ningún humano alcanza a supervisar nada, que toca pasarse al human-on-the-loop y dejar que la IA supervise a la IA. (MIT Technology Review, hace pocas semanas, llamó directamente al human-in-the-loop “una distracción reconfortante” en el contexto de guerra algorítmica.) Entiendo el argumento. No me convence — pero lo entiendo.

Lo que no me convence es la conclusión a la que arrastra: que como no podemos supervisar todo, mejor no supervisar nada. Eso, en cualquier otra industria, lo llamaríamos abandono.

Tú, yo, nosotros.

Habemos algunos que todavía pensamos que la pregunta importante no es si los agentes podrán unir los puntos solos algún día. Esa pregunta es entretenida pero un poco tramposa — pone el foco en la máquina cuando el foco debiese estar en nosotros.

La pregunta que me ronda es otra. Cuando la máquina termine antes que tú la frase que ibas a pensar — y va a pasar, está pasando ya con los autocompletados de cada IDE, de cada mail, de cada chat — ¿vas a seguir siendo el que decide cuál era la frase que importaba?

Y aquí me toca confesar algo incómodo. Yo soy parte del problema. Cada agente que diseño, cada flujo que automatizo en mi pega, es — en el fondo — un pedacito de mi propia obsolescencia. (Lo digo sin drama; es, literalmente, la pega.)

Las empresas que sobreviven más de una generación, dicen los manuales, son las que se canibalizan a tiempo. Apple acaba de sacar la MacBook Neo a 599 dólares — un laptop con chip de iPhone, casi indistinguible de la Air, pensado para comerse parte de su propio mercado antes de que se lo coma otro. Es brutal y elegante a la vez. Es decir: sobrevives en la medida en que estés dispuesto a asesinar la versión anterior de ti mismo.

Tal vez con uno pasa algo parecido. Tal vez el human-in-the-loop más honesto no es el que se aferra a su rol, sino el que lo va corriendo hacia adelante — soltando lo automatizable, quedándose con lo que todavía requiere observador.

O, dicho de otra manera, más incómoda: si Jamal hubiera tenido un agente que le susurrara las respuestas en tiempo real, ¿la película seguiría siendo conmovedora?

Tal vez. No estoy seguro.